Anywhere Sports ~どこでも好きな場所でMRでスポーツを~

開発中

© CC BY 4+

347

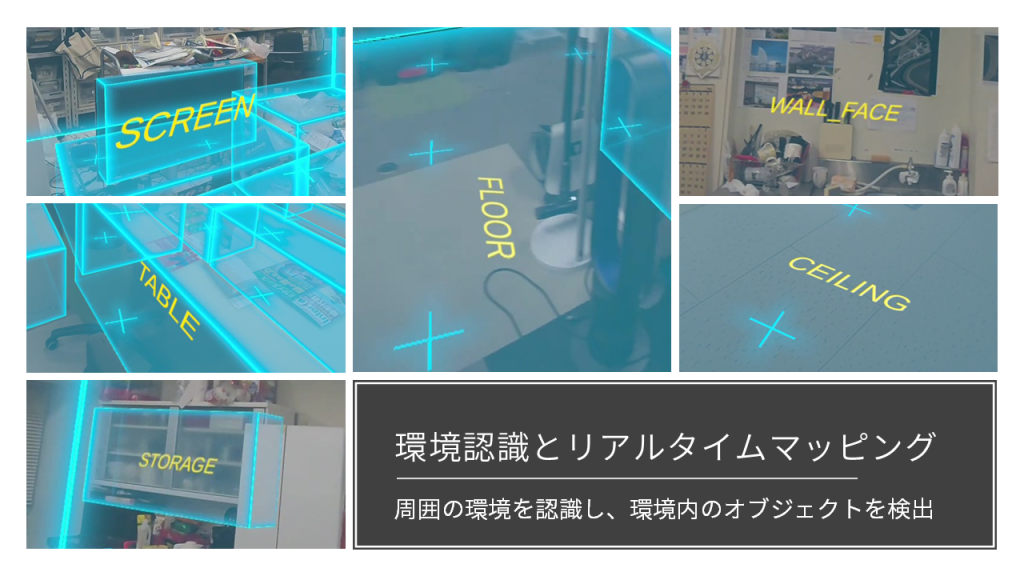

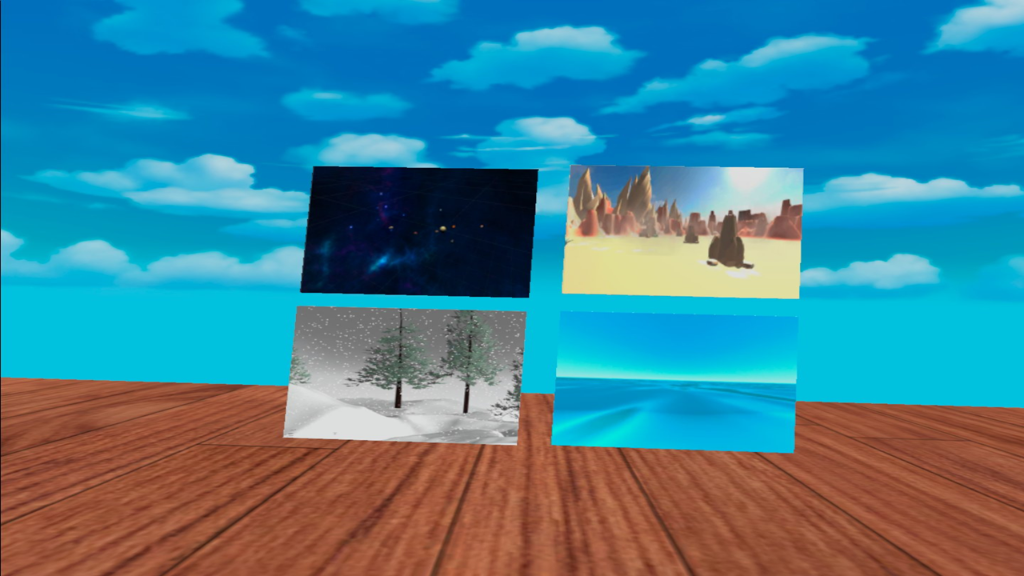

MR機能とシーン機能を用いて、どこでも(anywhere)好きな場所で、周囲の環境とのインタラクション要素を含んだスポーツ(sports)体験ができるコンテンツです。

- 動画

-

- 開発素材

-

デバイス

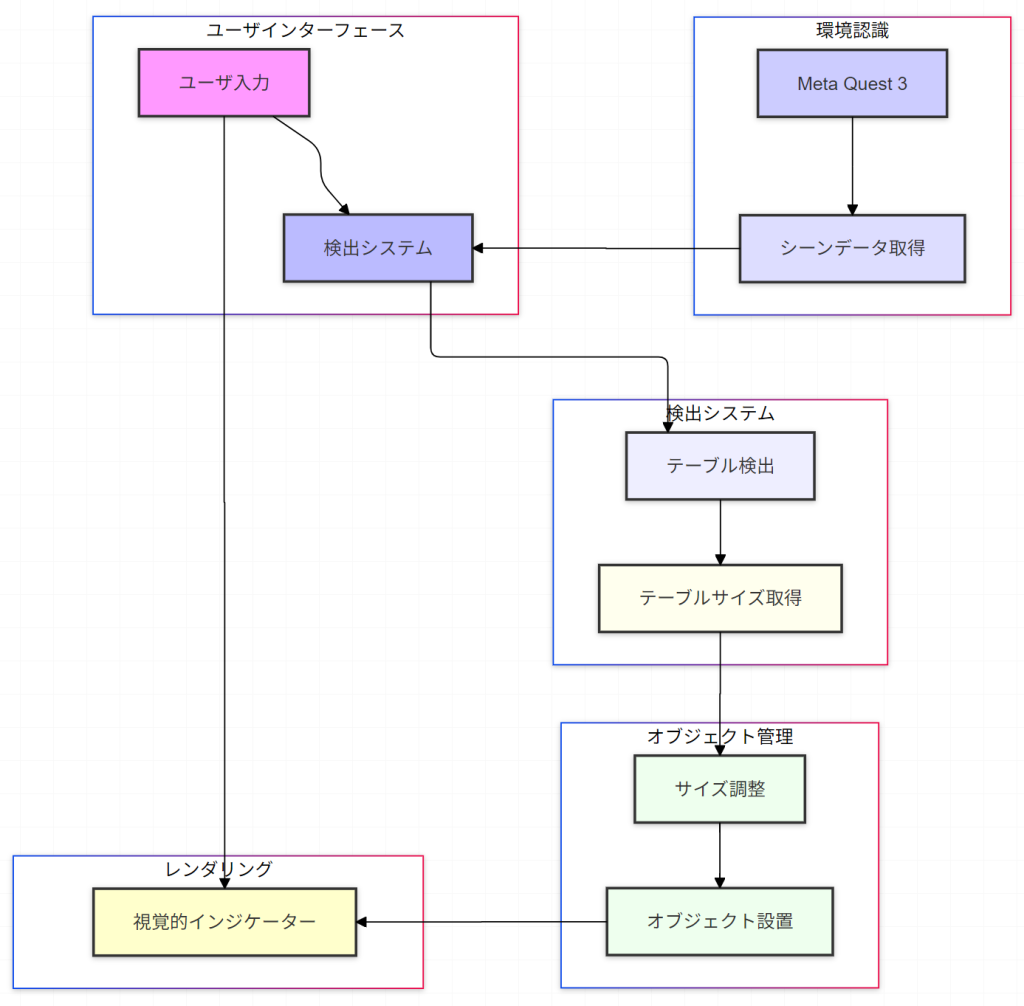

- システム構成

-

- ストーリー

-

- メンバー

-

-

- Amultart @amultart

-

-

- 関連イベント

-

-

ヒーローズ・リーグ 20242024-09-02 開催

ヒーローズ・リーグ 20242024-09-02 開催

-

アバナードHuman Impactリーグ2024-09-02 開催

アバナードHuman Impactリーグ2024-09-02 開催

-

- 同じニオイがする作品

-

-

のぞきVR

のぞきVR

-

human mapping

human mapping

-

漫才ジェネレータ

漫才ジェネレータ

-

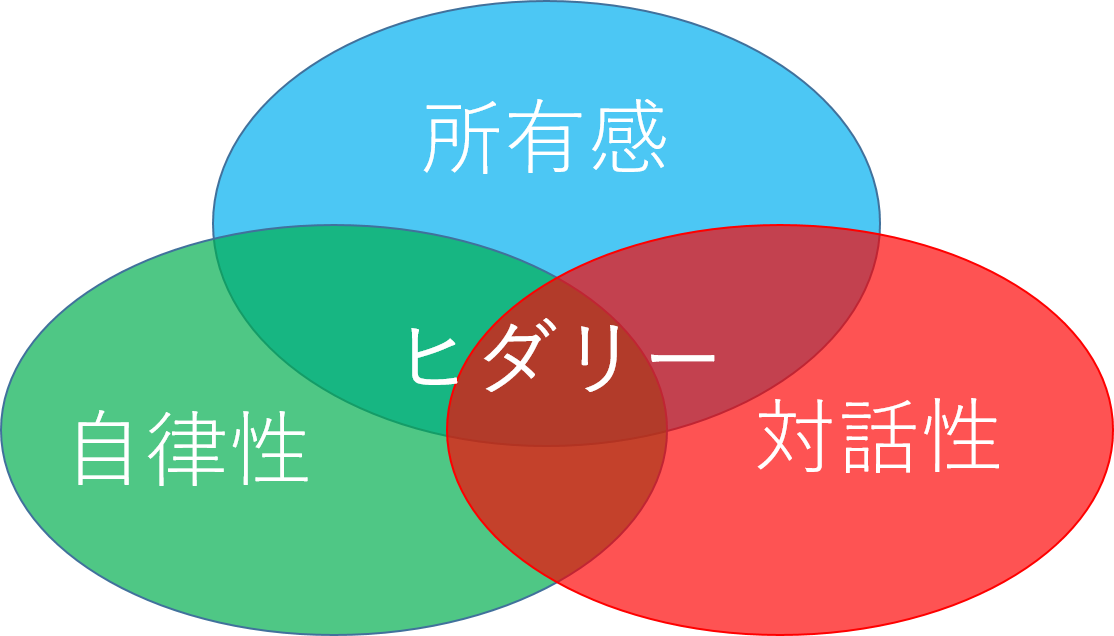

寄生ロボット「ヒダリー」

寄生ロボット「ヒダリー」

-